L’information concernant un prétendu pilote ukrainien fugitif est fausse, car il n’existe aucune preuve à cet égard. L’image présentée comme preuve a été générée par une intelligence artificielle.

Certains médias russes et des utilisateurs d’Internet diffusent la nouvelle selon laquelle un pilote non identifié des forces armées ukrainiennes aurait fui en Afrique, tombé amoureux d’une femme locale.

« Alors que de nombreux militaires des FAU quittent leurs positions pour des raisons financières ou idéologiques, un pilote ukrainien a fui en Afrique par amour pour une femme locale », indique la nouvelle.

La source de cette information est le canal Telegram prorusse « Ukropskiy fresh ». Dans leur publication, cette histoire est présentée plus en détail : un pilote ukrainien aurait soi-disant détourné un avion et s’est envolé vers un pays d’Afrique, où sa bien-aimée, avec qui il avait longuement correspondu par internet, l’attendait déjà.

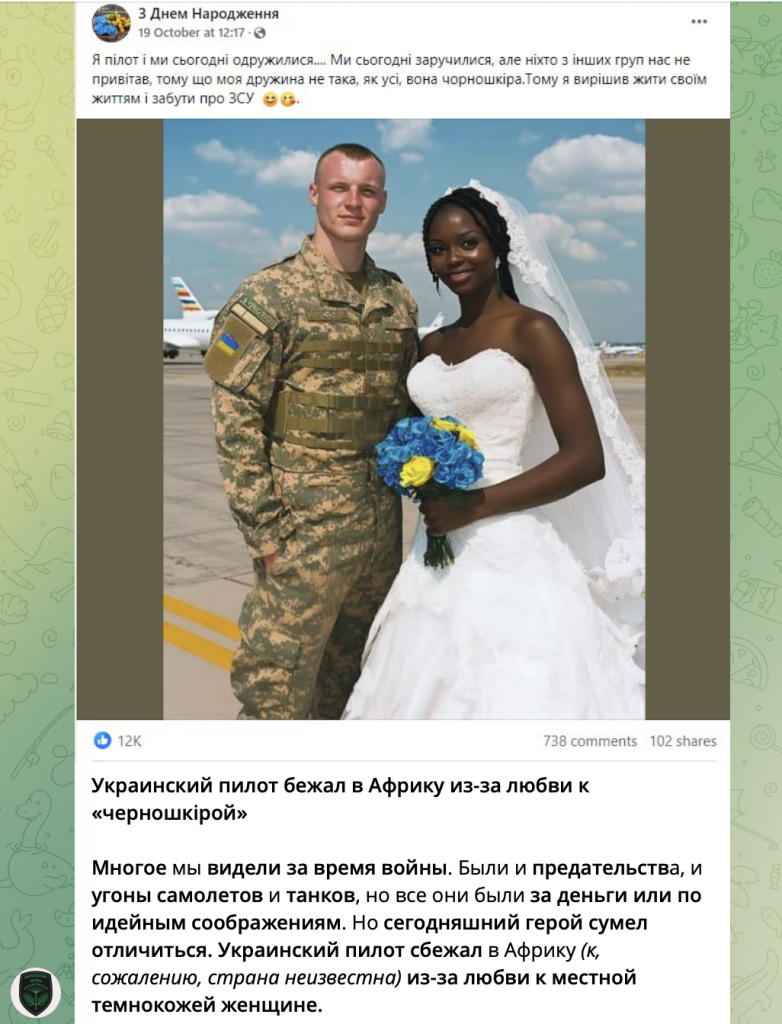

Le canal a publié une capture d’écran d’une page Facebook intitulée « С Днем рождения » (Joyeux Anniversaire) datée du 19 octobre, sur laquelle était prétendument affichée une photo d’un homme en uniforme militaire et d’une fiancée noire devant un avion. « Je suis pilote, et nous nous sommes mariés aujourd’hui… Nous nous sommes fiancés aujourd’hui, mais personne d’autre ne nous a félicités, car ma femme n’est pas comme les autres, elle est noire. C’est pourquoi j’ai décidé de vivre ma vie et d’oublier les FAU », indique la publication qui aurait soi-disant recueilli plus de 12 000 likes.

Capture d’écran – t.me/dillfrash

Actuellement, sur la page Facebook « Joyeux Anniversaire », il n’y a pas de publication du 19 octobre. Les services d’archivage web ne contiennent aucune information sur cette page. Cependant, le 22 octobre, une image identique avec la même légende est apparue sur cette même page, mais sans mention que « le militaire a quitté les forces armées et a décidé de vivre sa propre vie ». Il n’est pas possible de vérifier si une publication du 19 octobre a réellement existé et si elle disait que le militaire avait quitté le service. Même si une telle publication a effectivement existé, elle a pu être modifiée, photographiée, puis supprimée.

Cependant, l’image du militaire avec sa fiancée a été générée par une intelligence artificielle (IA). Même une analyse superficielle montre qu’elle est fausse : l’homme n’est pas vêtu d’un uniforme de pilote standardisé, mais d’une combinaison avec un camouflage inexistant. Les vêtements comportent également des sangles MOLLE, qui sont généralement fixées uniquement sur l’équipement.

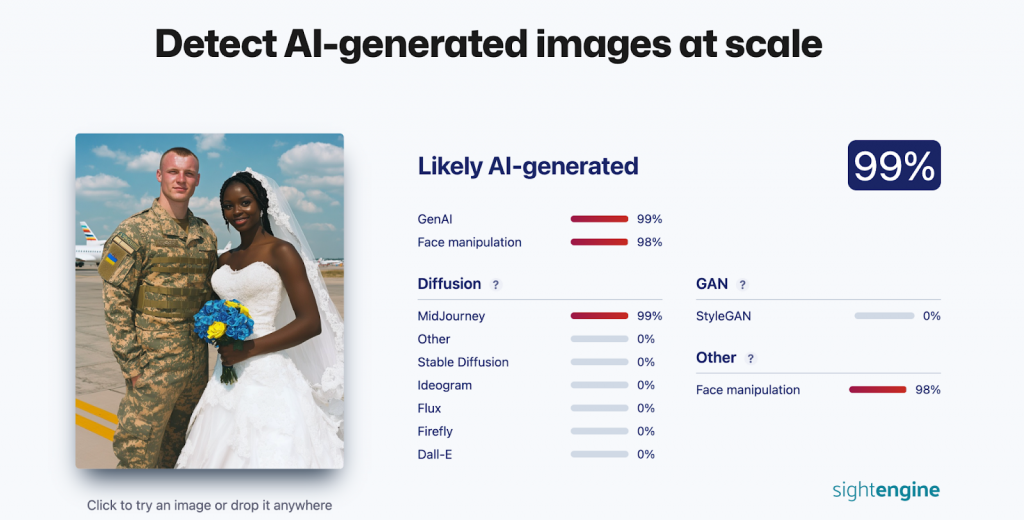

Des réseaux neuronaux, tels que Midjourney, Bing Image Creator, DALL-E ou DeepAI, peuvent créer du contenu entièrement nouveau ou transformer du contenu existant. Grâce aux outils AI or Not et Sightengine, les journalistes de StopFake ont confirmé leurs conclusions – cette image a été générée par un réseau neuronal, très probablement MidJourney.

Capture d’écran – sightengine.com

Des dizaines de publications similaires avec des images générées par intelligence artificielle circulent sur Internet. Dans beaucoup d’entre elles, il est affirmé que la photo montre un militaire ukrainien. Les auteurs des publications incitent les utilisateurs à aimer et à partager ces publications sur les réseaux.

Collage – StopFake

Les pages anonymes sur Facebook peuvent diffuser des photographies générées par l’intelligence artificielle pour plusieurs raisons, notamment pour augmenter l’interaction et la portée, créer de fausses communautés et manipuler les émotions des utilisateurs. Les pages qui publient systématiquement du contenu généré peuvent ainsi accroître leur visibilité sur les réseaux sociaux. Par la suite, ces pages peuvent changer de direction, de nom et être utilisées pour diffuser de la désinformation ou promouvoir des produits commerciaux.

Auparavant, StopFake a analysé un contenu similaire avec des images de militaires ukrainiens générées par une intelligence artificielle dans l’article « Faux photo : « Avdiivka demande des prières » – les militaires ukrainiens prient pour leur salut ». Cette analyse confirme que la diffusion d’images fausses avec des militaires peut faire partie d’une stratégie de désinformation plus large, visant à manipuler l’opinion publique et à créer de faux récits.