El mando supremo de las Fuerzas Armadas de Ucrania, el general Valeriy Zaluzhnyi no hizo tales declaraciones. El vídeo señalado es un montaje de alta calidad, un denominado ‘deepfake’, creado con la ayuda de la inteligencia artificial.

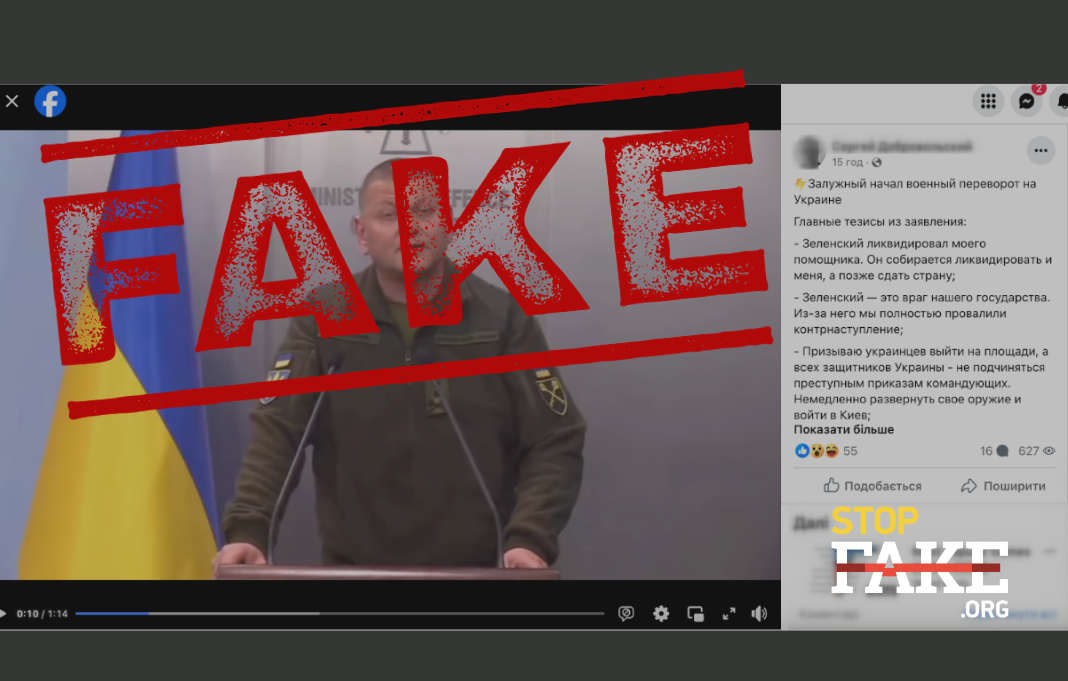

Está circulando por la red un vídeo en el que un hombre que se parece al comandante en jefe de las Fuerzas Armadas ucranianas, el general Valeriy Zaluzhnyi, declara que el presidente de Ucrania, Volodymyr Zelenskyy, supuestamente “ha liquidado” a su ayudante y está preparando la “entrega” del país al enemigo.

“Zelenskyy es un enemigo de nuestro país. Por su culpa, hemos fracasado completamente en la contraofensiva. Insto a los ucranianos a salir a las plazas, y a todos los defensores de Ucrania a no obedecer las órdenes criminales de los comandantes. Dad la vuelta inmediatamente a vuestras armas y entrad en Kyiv”, dice el hombre en el vídeo.

En realidad este vídeo es una falsificación de alta calidad, un denominado ‘deepfake’, creado con ayuda de inteligencia artificial. Al crear ‘deepfakes’ con vídeo, se superpone una imagen o un vídeo a otro. Esta manipulación utiliza una técnica de aprendizaje automático llamada GAN, una red generativa adversativa. Esta tecnología puede utilizarse para falsificar una voz. Para más detalles sobre cómo los actores maliciosos utilizan la inteligencia artificial para generar vídeos falsos, lea nuestro artículo: “Ultrafalso: las redes neuronales se convierten en más hábiles que los propagandistas”.

Utilizando la herramienta Deepware, se puede averiguar si un vídeo ha sido procesado artificialmente. Esta herramienta permite encontrar manipulaciones con caras generadas por inteligencia artificial. Deepware Scanner, tras analizar el vídeo atribuido al general Zaluzhnyi, descubrió que el vídeo era sospechoso y presentaba signos de interferencia.

El hecho de que estamos ante un ‘deepfake’ también lo indica la calidad del vídeo y el aspecto de la persona. Un análisis más atento revela una iluminación parpadeante, movimientos antinaturales de los párpados y la boca y, en algunos casos, una falta de correspondencia entre las expresiones faciales de la persona y su forma de hablar.

Mediante una búsqueda inversa de imágenes en Google, los periodistas de StopFake lograron encontrar el vídeo original, que muy probablemente se utilizó para crear el vídeo falso. Se trata de un discurso del comandante en jefe de las Fuerzas Armadas de Ucrania sobre la escalada de la situación en los territorios de primera línea de Ucrania publicado el 18 de febrero de 2022.

También cabe señalar que esta cinta generalmente se difunde en Internet por canales anónimos de Telegram y comunidades prorrusas. Los analistas del Centro de Lucha contra la Desinformación del Consejo Nacional de Seguridad de Ucrania consiguieron averiguar que el vídeo fue publicado por primera vez por el canal de Telegram Radio Truja, en cuya descripción se indica que también publican contenido humorístico.

«Con la difusión de estas noticias falsas, los ruscistas pretenden sembrar el pánico entre la población y convencerla de una división entre el Gobierno y los militares», escribe el Centro de Lucha contra la Desinformación. La agencia señala que ya el 7 de noviembre predijeron este tipo de operaciones especiales de información y psicología por parte del Kremlin.

Anteriormente StopFake había refutado información falsa de que el comandante en jefe Zaluzhnyi “había admitido el fracaso” de las FFAA de Ucrania en la guerra.