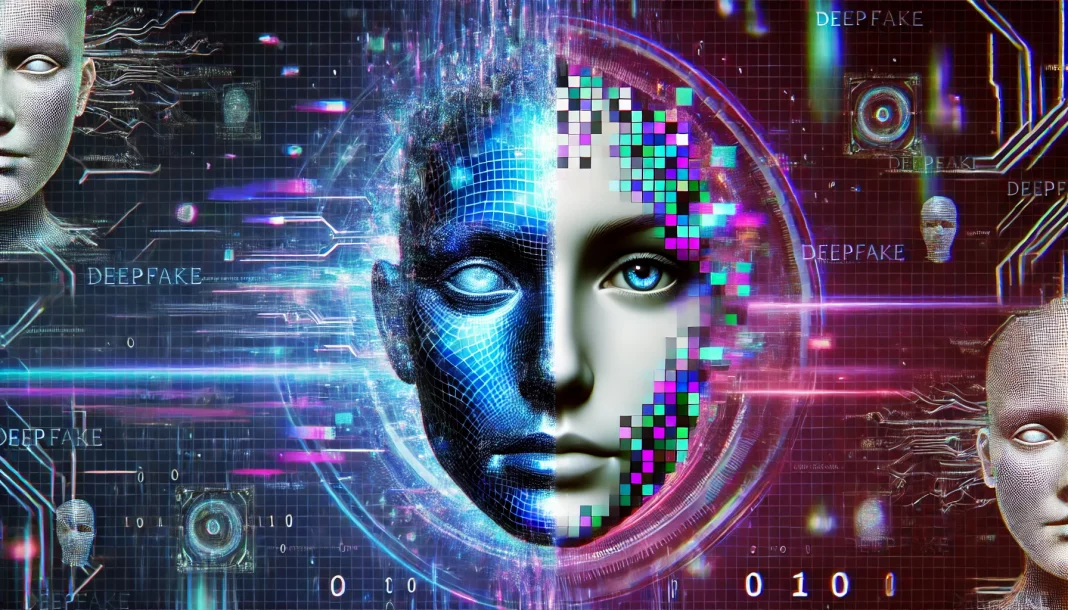

En una era de rápidos avances en inteligencia artificial, las amenazas de los deepfakes y la desinformación han alcanzado una escala sin precedentes. La creación de contenidos digitales falsos es más accesible que nunca, con graves consecuencias para la democracia y la confianza pública. En respuesta a estos retos, investigadores de la Universidad Tecnológica de Nanyang, en Singapur, propusieron en un artículo publicado en 2023, un sistema de defensa integrado. Se basa en cuatro pilares: tecnologías avanzadas de detección, iniciativas estratégicas, regulación y educación pública.

Pilares tecnológicos de la defensa

El primer elemento del sistema son los algoritmos avanzados de detección que analizan los contenidos multimedia para detectar posibles manipulaciones. Estas herramientas examinan, por ejemplo, irregularidades en la iluminación, patrones de respiración o anomalías en la textura de la piel. También es importante tener en cuenta las tecnologías de etiquetado digital, como las «marcas de agua» digitales o el uso de la tecnología blockchain, que pueden confirmar la autenticidad del contenido. La inteligencia artificial apoya estos procesos analizando las llamadas «huellas digitales» dejadas por modelos generados.

Sin embargo, la tecnología no está exenta de inconvenientes. A medida que aumenta la sofisticación de los deepfakes, los algoritmos de detección deben evolucionar constantemente, creando una carrera armamentística sin fin.

Iniciativas estratégicas y colaboración

El segundo aspecto clave del sistema propuesto es la colaboración entre plataformas digitales, empresas tecnológicas y gobiernos. Las redes sociales desempeñan un papel central en esta batalla, ya que es donde los deepfakes y la desinformación se propagan con mayor rapidez. Las estrategias propuestas incluyen la mejora de los mecanismos de moderación de contenidos con la ayuda de la inteligencia artificial y la aportación humana, la asociación con organizaciones de verificación de hechos y la introducción de herramientas para que los usuarios denuncien contenidos sospechosos.

Un elemento clave es también la educación de los usuarios, que debe ayudarles a reconocer los contenidos falsos y a entender cómo funcionan los mecanismos de deepfake.

Regulación legal y ética

El tercer pilar es el desarrollo de nuevas normativas que definan claramente y penalicen la creación y difusión de deepfakes. Se necesitan normas y mecanismos de aplicación internacionales, como el etiquetado de contenidos o el intercambio de datos entre plataformas.

Desde el punto de vista ético, se requiere hallar un equilibrio entre la protección de la libertad de expresión y la necesidad de protegerse contra la desinformación. La creación de comités de ética independientes puede ayudar a controlar los efectos de la aplicación de las novedades y reaccionar rápidamente ante una censura excesiva.

Educación y sensibilización del público

Por último, pero no por ello menos importante, está la educación. Los creadores del sistema propuesto subrayan que el éxito a largo plazo en la lucha contra los deepfakes pasa por la concienciación del público. Los programas educativos deben incluir el desarrollo del pensamiento crítico, aprender a distinguir entre contenidos falsos y reales, además de promover el uso de fuentes de información fiables.

Las iniciativas de sensibilización pública podrían contar con el apoyo de distintos sectores: escuelas, medios de comunicación y ONG´s. La introducción de certificados para contenidos verificados y el etiquetado de fuentes de información fiables en las plataformas de medios sociales podrían aumentar aún más la concienciación del público.